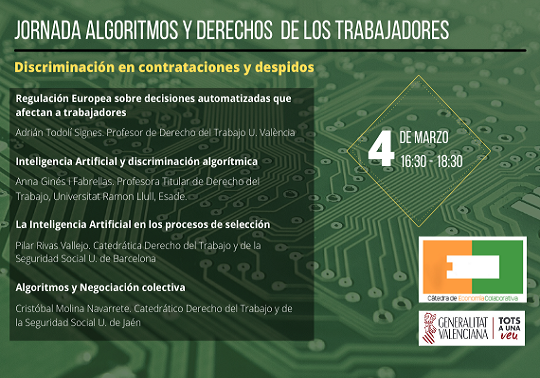

Aquest dimecres 4 de març, en el marc d'unes jornades de la Universitat de València organitzades per la Càtedra d’Economia Col·laborativa i Transformació Digital i amb el suport de la Fundació las Naves, un grup d'experts de diverses universitats espanyoles s'han reunit per a debatre sobre les diferents implicacions de l'ús d'algorismes i Intel·ligència Artificial en els processos de contractació i acomiadament, organització del treball, entre altres, així com sobre l'abast i les limitacions de la regulació vigent.

Així, els diferents ponents han estat d'acord a assenyalar que, si bé les decisions automatitzades poden ser eines molt útils per a les empreses, atés que, com ha remarcat el professor Todolí Signes, professor de Dret del Treball de la UVEG, la tecnologia ha facilitat i abaratit la recollida i el processament de dades, el seu ús porta associat determinats riscos, entre els quals destaca l'amplificació de biaixos preexistents, a través de diferents mecanismes. En aquesta línia, han insistit els participants, la major preeminència de determinats grups socials en el disseny algorítmic i la programació, el propi biaix de les fonts d'informació de les quals beuen els algorismes -tant en termes de sobrerepresentació d'algunes dades com manca o absència d'unes altres- tendeixen a afectar en gran manera minories o grups històricament discriminats. Així mateix, tal com remarca la professora Ginès i Fabrellas, ESADE, la reproducció de biaixos i estereotips de gènere són el paradigma de la discriminació algorítmica, i, encara que no es tracta de problemes nous, sí que se’n magnifiquen les seues conseqüències.

A tall d'exemple, la professora Rivas Vallejo, Universitat de Barcelona, ha explicat com el reclutament digital, basat en criteris que l'empresa facilita per a avaluar les competències i habilitats dels candidats, i a través de models matemàtics que s'alimenten de dades absorbeixen patrons socials de conducta i els reprodueixen, assumint-los com a bons -’el perfil que millor s'adapta a l'empresa’-, de manera que en els processos de cribatge i selecció de personal prioritzen a candidats amb característiques molt específiques. De la mateixa manera, els sistemes de reputació digitals tendeixen a afavorir determinats grups per damunt d'uns altres.

Davant aquests nous reptes, Ginès i Fabrella proposa superar la bretxa de dades, una major diversitat en els perfils que creen i codifiquen els algorismes, així com quotes en aquests, entre algunes de les possibles solucions per a eliminar els biaixos existents. Així mateix, les decisions algorítmiques no poden estar exemptes d'implicacions ètiques, que contemplen quina tipologia d'actuacions poden realitzar-se, així com quines variables poden o deuen tindre's en compte.

Quin és el tractament jurídic davant la discriminació algorítmica? Per a *Todolí Signes, la major vulnerabilitat dels treballadors enfront de les decisions laborals automatitzades ha facilitat que la regulació de protecció de dades es torne més garantista quan les decisions són preses per un algorisme que no per un responsable de Recursos humans, proposant disposicions que no sols protegeixen la intimitat i el dret a la no discriminació, sinó també drets d'informació per a l'afectat per una decisió automatitzada i fins i tot l'anomenat “dret a una explicació”. De fet, com es deriva de l'article 22 del Reglament General de Protecció de Dades Europeu 2016/679, com a regla general s'ha de partir de la prohibició de l'ús de decisions totalment automatitzades que afecten els drets dels treballadors. El professor Molina Navarrete, Universitat de Jaén, matisa que "la qüestió no és si s'ha de regular, que ja s'està fent, sinó qui i com". En aqueix sentit, s'ha posat l'accent en la necessitat d'avançar cap a la governança col·lectiva en matèria de protecció de dades, que incloga a actors diversos amb capacitat per a negociar els algorismes i congestionar-los, com una proposta que equilibre els poders de negociació dispars entre ocupadors i empleats.

Finalment, els ponents han insistit en la necessitat d'una major transparència, que facilite la comprensió de la presa de decisions, tant ex-ante com ex post. En la mateixa línia, en opinió dels experts és imprescindible reforçar el dret a una explicació, de manera que existisca i siga accessible informació completa dels fonaments utilitzats per la tecnologia per a prendre les decisions, ja que d'això depén evitar la indefensió dels afectats. Això pot comportar un difícil equilibri amb la protecció del secret industrial, encara que com matisa el professor Molina Navarrete, no seria tan necessari conéixer el funcionament tècnic com els riscos i resultats.

Aquest debat s'emmarca dins d'investigacions sobre com la tecnologia afecta al mercat de treball i als drets dels treballadors que duu a terme la Càtedra d'Economia Col·laborativa i Transformació Digital i entre les recents publicacions de la qual es troba una investigació titulada “Vigilància i control en el Dret del treball Digital”.