Un nuevo rol organizativo para la inteligencia artificial: paladín de una IA responsable

Dr. Richard Benjamins

Chief AI & Data Strategist, Telefónica

Cofundador y vicepresidente OdiseIA

Introducción

Con la creciente utilización de la Inteligencia Artificial (IA), se empieza a prestar más atención a sus posibles consecuencias negativas. Esto ha dado lugar a la proliferación de directrices éticas voluntarias o principios de la IA, mediante los cuales las organizaciones declaran públicamente que desean utilizar la IA de manera justa, transparente, segura, robusta, centrada en el ser humano, etc., evitando cualquier consecuencia negativa o daño.

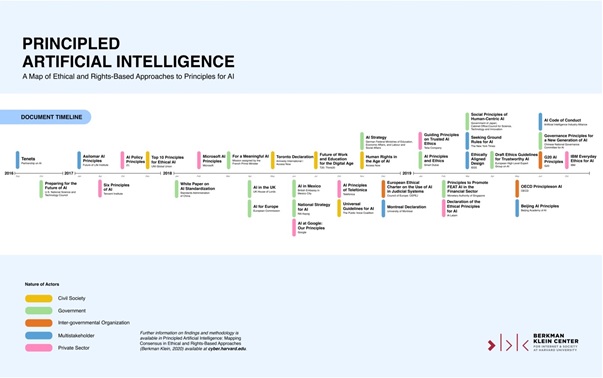

La Universidad de Harvard ha analizado los Principios de la IA de las primeras 36 organizaciones del mundo que publicaron dichas directrices y ha encontrado 8+1 categorías más utilizadas, entre las que se encuentran: los valores humanos, la responsabilidad profesional, el control humano, la equidad y la no discriminación, la transparencia y la explicabilidad, la seguridad y la protección, la rendición de cuentas, la privacidad y (+1) los derechos humanos. En la siguiente imagen se muestra el calendario de publicación de las Directrices de la IA en estas 36 organizaciones.

La organización, sin ánimo de lucro, Algorithm Watch, cuenta con un inventario de Directrices de Inteligencia Artificial que actualmente contempla más de 160 organizaciones.

De Principios a la práctica

Si bien hay muchos trabajos dedicados a la elaboración y el análisis de directrices o principios de la IA, se sabe mucho menos sobre el proceso de aplicar esos principios en el día en día de una organización (Business as Usual – BAU). Las primeras experiencias sobre cómo aterrizar estos principios en la práctica en una empresa como Telefónica, y cómo elegir los principios se van compartiendo y publicando, y la experiencia se va acumulando gracias a organizaciones como el World Economic Forum, la Universidad de Berkeley y el departamento de defensa de la EEUU.

La metodología de Telefónica, denominada “Responsible AI by Design”3, incluye varios elementos:

- Los principios de la IA que establecen los valores y los límites

- Un conjunto de preguntas y recomendaciones, que garantizan que todos los principios de la IA sean debidamente examinados en todo el ciclo de vida del producto

- Herramientas que ayudan a responder algunas de las preguntas, y ayudan a paliar cualquier problema identificado

- Capacitación, tanto técnica como no técnica

- Un modelo de gobernanza que asigne responsabilidades

Aquí nos centramos en un nuevo papel organizativo que es esencial para poner en práctica el uso responsable de la IA en una organización; el rol juega un papel crítico en el modelo de gobernanza y lo hemos acuñado como “paladín de una IA responsable” (Responsible AI Champion).

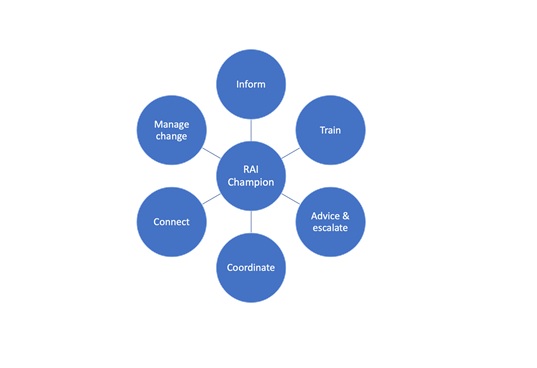

El paladín de una IA responsable

¿Por qué necesitamos paladines? El área que se ocupa de la ética en la IA es nueva en muchas organizaciones y para establecer estas nuevas áreas el papel de paladines es necesaria. Un paladín conoce el área, está disponible para los compañeros de trabajo en una determinada geografía o unidad de negocio, y proporciona concienciación, asesoramiento y asistencia si es necesario. Los paladines también son cruciales para convertir las nuevas prácticas en BAU como agentes de cambio. En concreto, las responsabilidades de un paladín de la IA son informar, educar, aconsejar y escalar, coordinar, conectar y gestionar el cambio.

Veremos un poco más en detalle cuales son las funciones principales del paladín de una IA responsable.

Informar

Un paladín de una IA responsable informa a sus compañeros sobre la importancia de aplicar la ética en la IA y los datos para evitar daños no intencionados. Él o ella crea conciencia de los principios de la IA en la organización.

Educar

Un paladín de una IA responsable proporciona y organiza la formación -tanto online como presencial- a su correspondiente unidad de negocio o geografía, explicando cómo aplicar los principios en el ciclo de vida del producto. También explica el modelo de gobernanza y alienta a los expertos autodidactas a formar una comunidad de práctica voluntaria en la que los empleados “locales” pueden obtener asesoramiento de primera mano.

Asesorar y escalar

Un paladín de una IA responsable es el último contacto “local” para cuestiones éticas sobre las aplicaciones de la IA y el Big Data. Si ni los expertos, ni el paladín de la IA pueden abordar el tema en cuestión, se eleva a un grupo de expertos multidisciplinario y de alto nivel.

Fuente: https://unsplash.com/photos/tGBXiHcPKrM

Coordinar

Dado que la IA y el Big Data hacen referencia a aspectos tratados en otros departamentos, los paladines de una IA responsable deben coordinarse con todas ellas. Es necesario coordinarse con el DPO (data protection officer) para las cuestiones relacionadas con la privacidad; con el CISO (chief information and security officer) para los aspectos relacionados con la seguridad; con el CDO (chief data officer) para los temas relacionados con los datos y la IA; con el CSR (corporate social responsibility) para las cuestiones de reputación y sostenibilidad; con el área de Regulación para posibles regulaciones futuras de la IA; y con el área Legal para otras cuestiones legales.

En algunas organizaciones, el uso responsable de la IA y el Big Data forma parte de una iniciativa de “responsabilidad” más amplia que incluye temas como la sostenibilidad, el cambio climático, los derechos humanos, la cadena de suministro justa y la reputación. En este caso, el paladín de una IA responsable debería coordinar y estar plenamente alineado con los respectivos líderes.

Conectar

Los paladines de una IA responsable necesitan conectar a personas competentes para formar comunidades de expertos en la materia. Esas comunidades son el primer lugar al que acudir si las dudas éticas no pueden ser resueltas dentro de un equipo. Los paladines de una IA responsable también necesitan formar una comunidad entre ellos, conectando diferentes geografías y unidades de negocio de la organización en una red activa de aprendizaje e intercambio. Por último, las organizaciones más desarrolladas también pueden considerar la posibilidad de establecer o unirse a una red externa de paladines (o similar) en la que se compartan experiencias y prácticas con otras organizaciones, ya sea del mismo sector o de sectores diferentes.

Gestionar el cambio

Finalmente, los paladines de una IA responsable son agentes del cambio. Tienen que asegurarse de que con el tiempo, las cuestiones éticas se conviertan en una parte íntegra y natural de cualquier actividad en la organización que toque la IA y el Big Data, incluyendo: el diseño, el desarrollo, las adquisiciones y las ventas. Tienen que implementar y convertir el modelo de gobierno en BAU.

La figura resume las principales funciones de un paladín de una IA responsable.

El perfil del paladín de una IA responsable

Para las organizaciones que están empezando, el paladín de una IA responsable es más un papel que un trabajo a tiempo completo. Normalmente, el rol es asumido por entusiastas de la IA o del Big Data que han investigado temas de ética por sí mismos sin que se les pregunte, y están pendientes de los nuevos avances. Pero el papel de paladín de una IA responsable no es necesariamente solo el ámbito de los perfiles técnicos. También llegan de áreas como la regulación, la RSC y la protección de datos. De hecho, un “buen” candidato para asumir el papel es el DPO.

Los paladines de una IA responsable deben ser comunicativos y estar interesados en enseñar y persuadir. Al igual que con cualquier nuevo papel de carácter interdisciplinario, los paladines de una IA responsable tendrán que recibir formación antes de poder ejercer su función.

Chief AI & Data Strategist, Telefónica

Cofundador y vicepresidente de OdiseIA.

Experto en Inteligencia Artificial y líder del uso responsable de IA en Telefónica. Gran impulsor del uso de Big Data e IA para el bien social. Miembro del Grupo de Expertos “B2G data-sharing” de la Comisión Europea.